Kebocoran Kode Sumber Claude Code: Analisis Industri Mendalam—Visi Anthropic Melampaui Hanya Sebatas Asisten Pengkodean AI

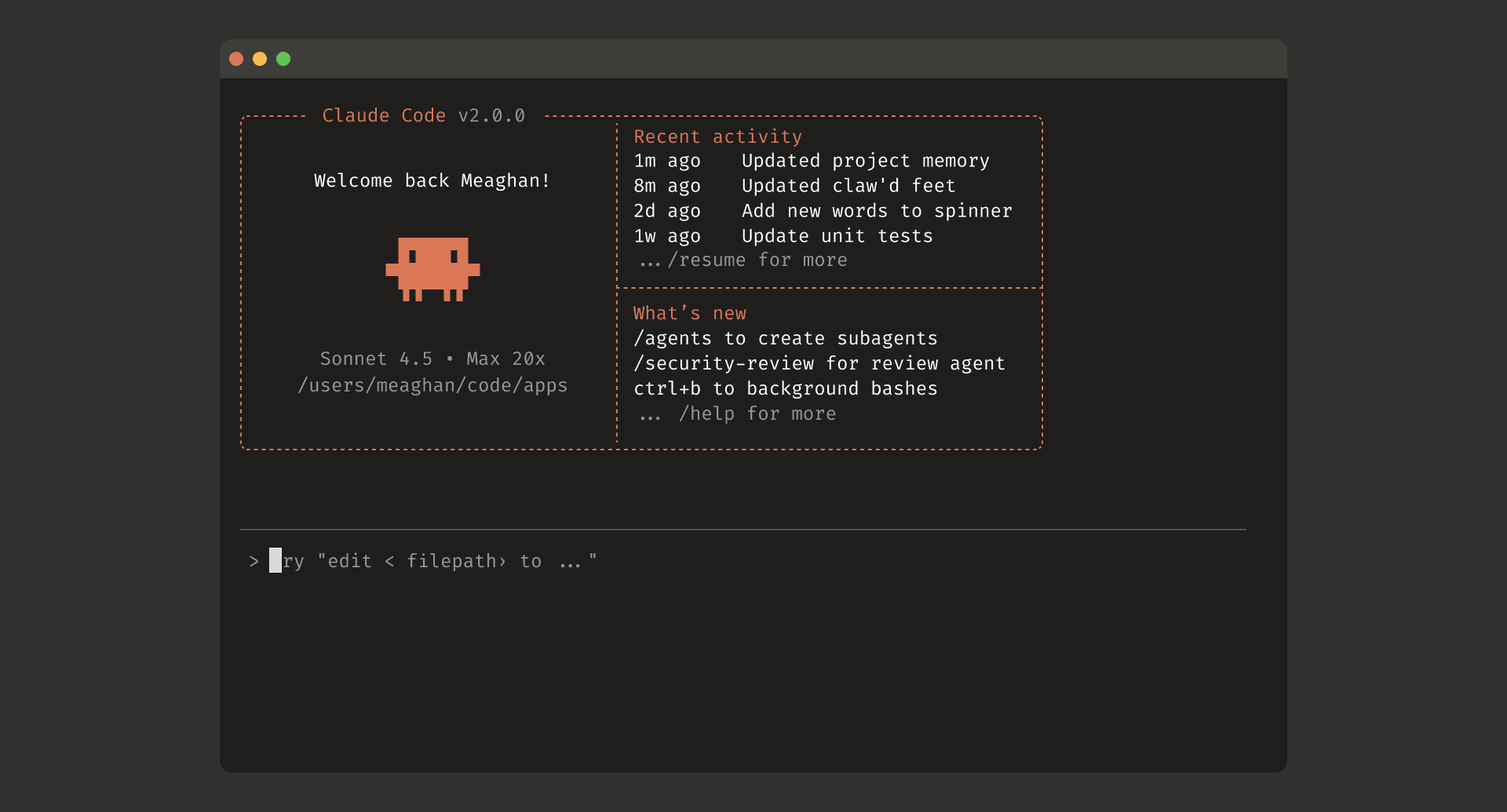

Sebuah kesalahan rilis rutin secara tak terduga membuka akses publik terhadap masa depan Claude Code. Sekitar 31 Maret 2026, paket npm Anthropic @anthropic-ai/claude-code versi 2.1.88 ditemukan memuat file cli.js.map. Karena source map ini berisi banyak sourcesContent, peneliti berhasil merekonstruksi sebagian besar kode sumber TypeScript aslinya. Insiden ini pun cepat menyebar di komunitas pengembang dan media.

Sekilas, ini tampak seperti kelalaian teknis. Namun dari sudut pandang industri, makna utama dari kebocoran kode sumber Claude Code bukan pada “kebocoran” itu sendiri—melainkan, untuk pertama kalinya, pihak eksternal dapat mengamati, pada level kode (bukan sekadar demo resmi), apa yang benar-benar sedang dikembangkan Anthropic dengan Claude Code.

Intinya sangat jelas:

Ambisi Anthropic jauh melampaui sekadar membangun AI CLI yang dapat menulis kode. Perusahaan ini tengah mengembangkan sistem agen yang mampu beroperasi terus-menerus, mengeksekusi secara proaktif, berkoordinasi multi-agen, dan benar-benar terintegrasi dalam alur kerja pengembangan.

Apa yang Terungkap dari Kebocoran Kode Sumber Claude Code?

Mari kita tegaskan fakta-faktanya.

Berdasarkan informasi publik, hal-hal berikut sudah jelas:

- Paket yang terdampak adalah @anthropic-ai/claude-code versi 2.1.88.

- Kebocoran kemungkinan besar disebabkan oleh kesalahan konfigurasi build atau packaging, bukan serangan peretas.

- Source map mengekspos sejumlah besar kode sumber ke pihak eksternal.

- Anthropic menegaskan tidak ada data atau kredensial pelanggan yang bocor—hanya kode sumber internal yang terpapar.

Apa artinya ini?

Meskipun memalukan, insiden ini pada dasarnya bukanlah krisis keamanan data pengguna. Sebaliknya, ini merupakan “pengungkapan roadmap produk yang tak terduga.” Bagi pengamat industri AI, informasi seperti ini sering kali lebih berharga daripada acara pers—karena kode sumber lebih jujur daripada copy pemasaran. Apa yang benar-benar menjadi fokus tim biasanya langsung tercermin pada kode, toggle fitur, dan sistem prompt.

Dari Kode Sumber: Claude Code Berevolusi dari Alat Menjadi Sistem

Dari fitur-fitur yang telah diidentifikasi sejauh ini, jelas bahwa semuanya bukan kemampuan terpisah—melainkan dibangun berdasarkan satu arah yang terintegrasi.

Dari fitur-fitur yang telah diidentifikasi sejauh ini, jelas bahwa semuanya bukan kemampuan terpisah—melainkan dibangun berdasarkan satu arah yang terintegrasi.

Claude Code tengah bertransisi dari “asisten pemrograman reaktif” menjadi “sistem agen yang berjalan terus-menerus.”

Alat coding AI sebelumnya umumnya bekerja seperti ini:

- Pengguna mengirim permintaan.

- Model mengembalikan kode atau saran.

- Interaksi berakhir.

- Pengguna harus memicu sesi berikutnya secara manual.

Namun, petunjuk dari kode yang bocor menunjukkan bahwa Anthropic melangkah ke tahap berikutnya. Fokus baru bukan lagi sekadar “jawaban yang lebih cerdas,” melainkan apakah sistem dapat secara otonom dan berkelanjutan mendorong tugas-tugas ke depan.

Inilah pergeseran paling signifikan bagi Claude Code.

KAIROS, PROACTIVE, dan COORDINATOR—Rencana Anthropic untuk Claude Code sebagai Agen Sejati

Di antara elemen yang paling banyak dibahas dari kebocoran ini adalah beberapa feature flag yang sering muncul: KAIROS, PROACTIVE, dan COORDINATOR_MODE.

Nama-nama tersebut bukanlah poin utama—yang penting adalah maknanya bagi produk.

KAIROS: Menjaga Claude Code Aktif dalam Jangka Panjang

Analisis publik menyebutkan bahwa KAIROS adalah semacam mode latar otonom. Sederhananya, Claude Code tidak lagi sekadar alat “tanya-jawab” sementara, melainkan dapat berjalan di latar belakang, menjaga konteks, mendengarkan event, mengintegrasikan memori, dan terus bekerja dalam kondisi tertentu.

Hal ini menunjukkan Anthropic berupaya mengubah Claude Code dari program yang bisa dipanggil menjadi sistem yang selalu hadir.

Ini adalah perubahan penting bagi pengguna. Pekerjaan pengembangan nyata tidak selesai hanya dengan satu prompt—banyak tugas berlangsung selama berjam-jam, berhari-hari, bahkan lebih lama. Jika AI hanya bisa memberi jawaban satu kali, ia tetap hanya asisten. Namun jika dapat menindaklanjuti secara berkelanjutan, ia mulai berperan seperti “rekan kerja.”

PROACTIVE: Mengambil Inisiatif Tanpa Menunggu Input Pengguna

Mode PROACTIVE menandakan sesuatu yang lebih langsung: Claude Code dapat terus memproses tugas dan mencari langkah berikutnya—bahkan saat pengguna tidak aktif.

Secara ringkas, Anthropic berupaya memecahkan tantangan lama pada produk AI:

Akankah AI mengambil inisiatif?

Sebagian besar alat AI saat ini masih “Anda bertanya, saya jawab.” Namun alur kerja yang benar-benar efisien tidak bisa selalu mengandalkan trigger manual. Yang dibutuhkan adalah sistem yang, setelah diberi tujuan, dapat memecahnya, menjalankan secara otonom, melaporkan hasil, dan hanya melibatkan pengguna pada titik-titik penting.

Jika Anthropic berhasil, bentuk produk Claude Code akan berubah secara fundamental.

COORDINATOR: Kolaborasi Multi-Claude untuk Tugas Kompleks

COORDINATOR_MODE mengindikasikan Anthropic tidak lagi melihat tugas kompleks sebagai masalah satu agen, melainkan membutuhkan kolaborasi multi-agen.

Dalam mode ini, Claude bertindak sebagai koordinator—membagi tugas riset, coding, dan validasi ke agen pekerja yang berbeda, lalu mengumpulkan dan mengintegrasikan hasilnya. Logikanya mirip tim nyata: sebagian anggota mengawasi, sebagian mengeksekusi, sebagian lagi memverifikasi.

Hal ini menunjukkan Anthropic memahami masa depan produk AI:

Sistem yang paling bernilai belum tentu memiliki satu model paling canggih, tetapi mampu mengorkestrasi banyak agen secara stabil dan terkontrol.

Apa Selanjutnya untuk Claude Code?

Dari perspektif analisis industri, Anthropic kemungkinan besar akan mengembangkan Claude Code ke empat arah utama.

1. Upgrade dari “Command-Line Tool” menjadi “Resident Development Environment”

Saat ini, bentuk Claude Code yang paling intuitif adalah CLI, namun kecil kemungkinan akan berhenti di CLI saja.

CLI hanyalah titik masuk, karena pengembang paling nyaman di sana. Dalam jangka panjang, Anthropic kemungkinan akan meningkatkan “kemampuan resident” Claude Code, menjadikannya lebih seperti komponen environment pengembangan yang berjalan di latar belakang. Anda bisa memanggilnya dari terminal, tapi tidak terbatas pada terminal. Ia bisa terhubung ke GitHub, sistem notifikasi, status tugas, dan memori tim, serta terus bekerja meski pengguna tidak aktif memantau.

Artinya, Claude Code akan bergeser dari “command-line tool” menjadi “infrastruktur alur kerja pengembangan.”

2. Berevolusi dari “Single-Generation” menjadi “Continuous Task Advancement”

Anthropic kemungkinan akan memperkuat eksekusi proaktif.

Mengapa? Karena ini adalah salah satu poin persaingan terpenting untuk generasi berikutnya dari produk coding AI. Banyak alat saat ini sudah bisa menulis kode, sehingga perbedaannya semakin kecil. Pembeda sesungguhnya adalah siapa yang bisa menyelesaikan tugas kompleks sampai tuntas, bukan sekadar menghasilkan potongan kode.

Jadi, langkah berikutnya untuk Claude Code bukan hanya memperbaiki code completion, tetapi meningkatkan kemampuan berikut:

- Memecah tugas secara otomatis

- Memanggil alat secara berkelanjutan

- Melakukan pengecekan mandiri selama tugas berjalan

- Melaporkan ke pengguna pada titik-titik penting

- Menjaga kesinambungan konteks untuk tugas jangka panjang

Ini akan membuat Claude Code lebih mirip “sistem yang berjalan sendiri” daripada “antarmuka model tanya-jawab.”

3. Transisi dari “One AI” ke “Multi-Agent Orchestration Platform”

Konsep koordinator yang terungkap dalam kebocoran ini sangat signifikan.

Rekayasa perangkat lunak kompleks tidak cocok untuk AI satu benang. Membaca kode, memodifikasi, menguji, dan memvalidasi pada dasarnya adalah proses paralel multi-peran. Anthropic kemungkinan akan terus menyempurnakan struktur “agen utama + agen pekerja + agen verifikasi.”

Jika arah ini berlanjut, Claude Code pada akhirnya mungkin akan terlihat seperti ini:

- Agen utama memahami tujuan dan membuat rencana

- Beberapa sub-agen menjalankan sub-tugas secara paralel

- Agen verifikasi independen melakukan pemeriksaan adversarial

- Pengguna hanya turun tangan pada titik-titik krusial

Ini bukan sekadar peningkatan chat—ini adalah perombakan alur kerja.

4. Dari “Mampu Bertindak” ke “Tindakan yang Terkendali”

Jika Anda sudah melihat banyak produk agen, Anda akan melihat tantangan umum: bukan tentang membuat mereka bekerja, tetapi mencegah mereka bertindak di luar kendali.

Itulah sebabnya perizinan, sandboxing, dan pengecekan keamanan menjadi perhatian utama. Anthropic kemungkinan akan terus menyeimbangkan “otomasi” dengan “kontrol.” Interupsi pengguna akan diminimalkan, namun otonomi tanpa batas tidak akan diberikan.

Fokus berikutnya untuk Claude Code kemungkinan adalah:

- Hirarki perizinan yang lebih cerdas

- Penilaian risiko yang lebih rinci

- Batas operasional yang lebih stabil

- Audit dan pelacakan yang lebih baik

Begitu agen benar-benar masuk ke alur kerja pengembangan perusahaan, batas keamanan dan tanggung jawab menjadi lebih penting daripada “unjuk kemampuan.”

Insiden Ini Menunjukkan Persaingan di Alat Coding AI Telah Bergeser

Kebocoran kode sumber Claude Code layak dicermati karena menyoroti tren besar industri: persaingan antar produk coding AI telah bergeser dari “siapa yang menulis kode lebih baik” menjadi “siapa yang bisa menghadirkan sistem kerja yang utuh.”

Dulu, fokusnya pada kemampuan model: siapa yang menghasilkan kode paling akurat, siapa yang punya context window lebih panjang, siapa yang benchmark-nya lebih tinggi. Kini, persaingan ada pada kemampuan sistem: siapa yang bisa mengintegrasikan lebih banyak alat, meminimalkan interupsi, berjalan terus-menerus, mengorkestrasi multi-agen, dan menyatu dengan alur kerja tim.

Singkatnya, pemenang di masa depan bukan yang “paling mirip chatbot,” tetapi yang “paling mirip sistem operasi kerja.”

Dalam konteks ini, arah Anthropic untuk Claude Code sudah jelas. Tujuannya bukan sekadar membangun plugin asisten pemrograman, melainkan mendefinisikan “environment pengembangan AI-native.”

Apa Artinya bagi Pengguna?

Bagi pengembang dan tim, ini memiliki dua implikasi utama:

- Peluang Efisiensi: Jika Anthropic benar-benar mengembangkan Claude Code menjadi sistem kolaborasi multi-agen yang berjalan di latar belakang dan proaktif, hubungan antara pengembang dan AI akan berubah. Anda tidak perlu lagi menulis setiap langkah sebagai prompt. Sebaliknya, Anda memberikan tujuan, batasan, dan parameter, lalu sistem yang menangani detailnya.

- Tantangan Kontrol: Semakin proaktif AI, semakin penting bagi pengguna untuk tahu apa yang sedang dilakukan, mengapa dilakukan, apakah sudah mendapat izin, dan siapa yang bertanggung jawab jika terjadi masalah. Indikator utama alat coding AI di masa depan bukan hanya “bisa atau tidaknya menyelesaikan tugas,” tetapi “apakah Anda bisa mempercayakan tugas itu.”

Karena itu, keunggulan kompetitif sejati Claude Code bukan sekadar pembaruan model, tetapi rekayasa produk dan tata kelola sistem.

Kesimpulan

Kebocoran kode sumber Claude Code mungkin terlihat seperti insiden rekayasa yang memalukan, namun sebenarnya ini adalah preview produk yang tak disengaja. Insiden ini memberi publik gambaran awal tentang visi Anthropic untuk Claude Code—yang kemungkinan bukan hanya asisten coding AI yang lebih kuat, tetapi sistem multi-agen yang berjalan lama, proaktif, dan dapat diintegrasikan secara aman ke alur kerja nyata.

Jika ini terbukti, masa depan Claude Code bukan sekadar “membantu Anda menulis kode”—tetapi “terus mendorong pekerjaan pengembangan Anda.”

Dan yang sebenarnya dituju Anthropic bukan sekadar peringkat model yang lebih tinggi, melainkan kepemilikan atas alur kerja pengembangan AI generasi berikutnya.

Artikel Terkait

Apa itu ERC-8183? Memahami Standar Komersial untuk AI Agents serta Fondasi Ekonomi Agen Terdesentralisasi

Cara Mengurangi Biaya Token di Era AI: Strategi Praktis Mulai dari Optimasi Prompt hingga Pemilihan Model

Membangun Moat Pribadi Anda di Era AI: Lima Strategi Esensial untuk Tetap Relevan dan Menghindari Tergantikan